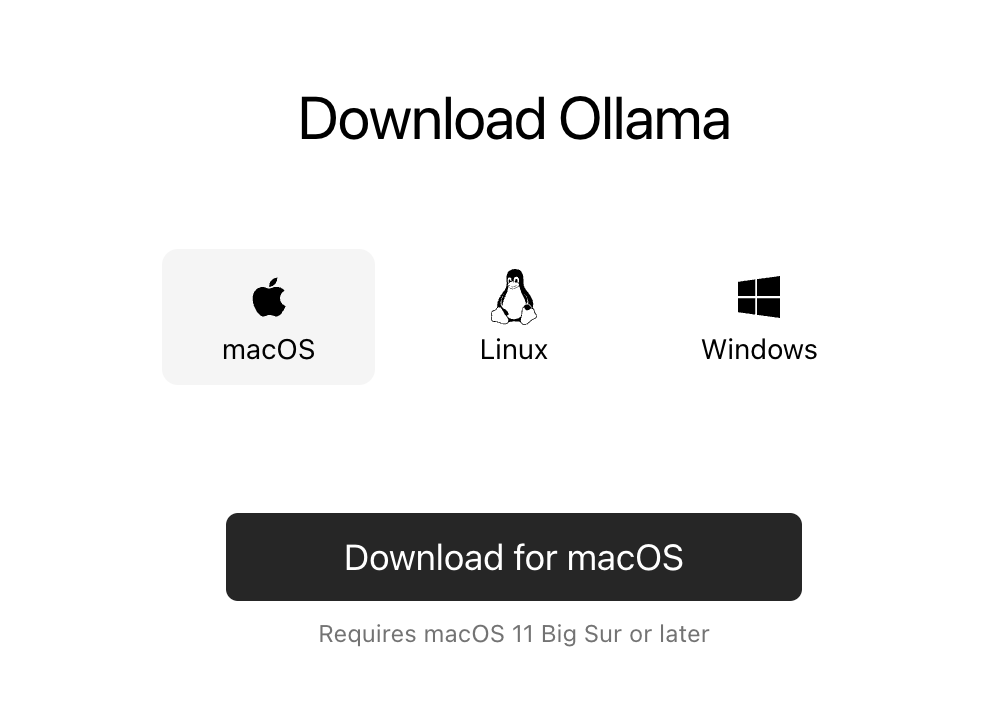

一、安装ollama

进入ollama下载页面,根据自己的操作系统选择对应的版本后点击download下载

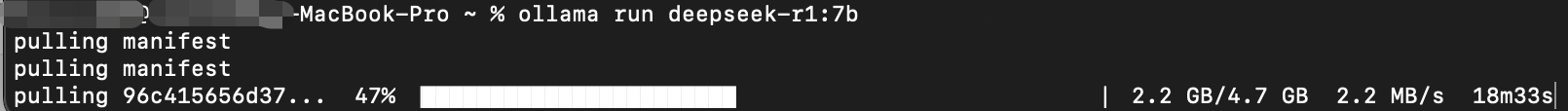

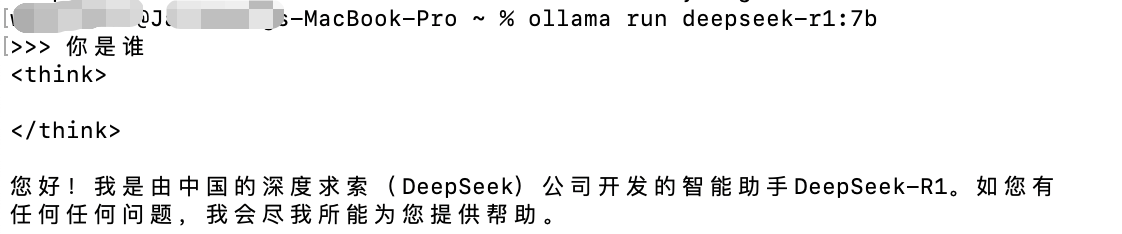

二、下载运行模型

执行下面的命令,或在ollama Models页面选择需要运行的模型

ollama run deepseek-r1:7b

三、使用第三方平台调用Ollama API

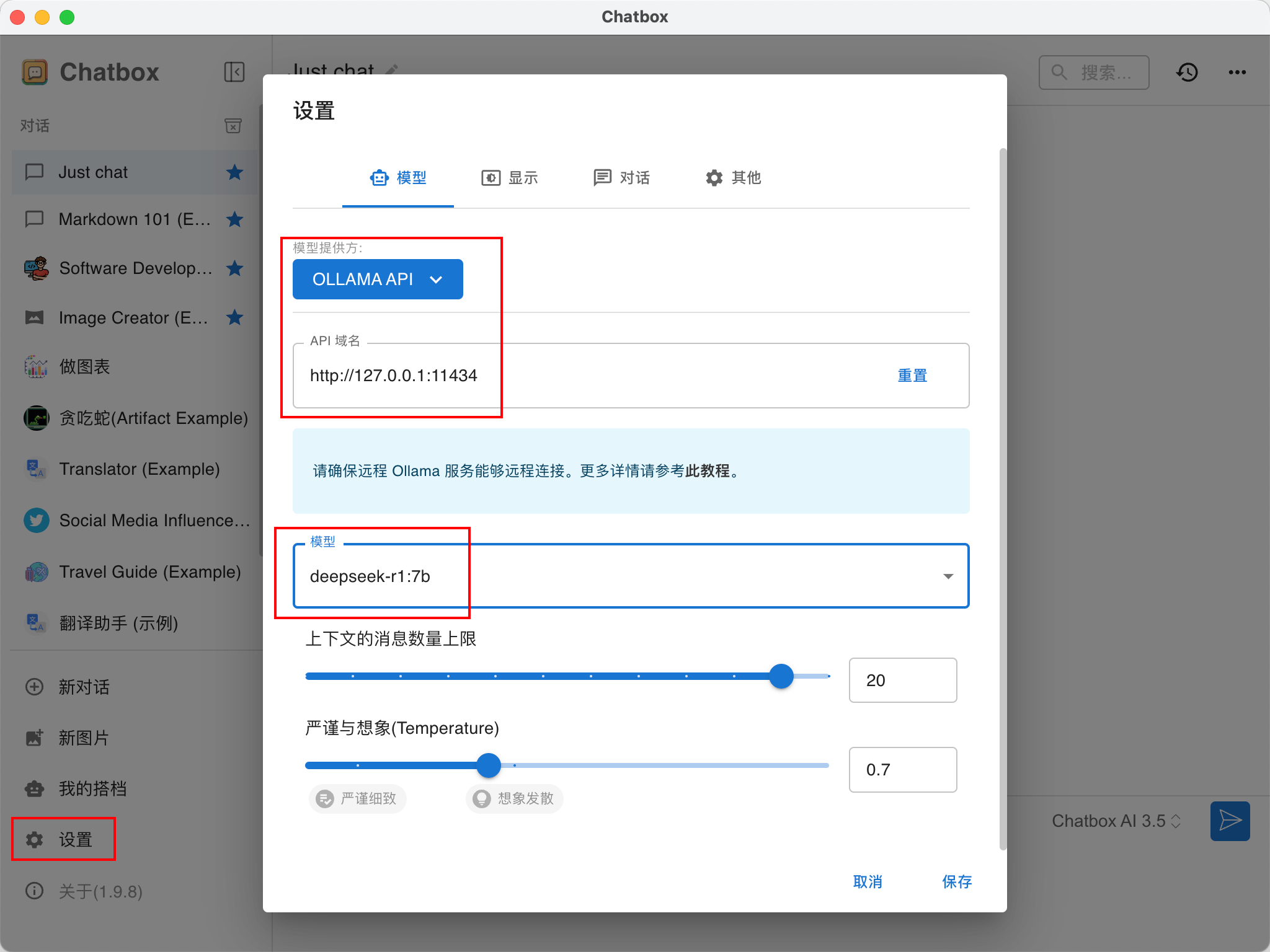

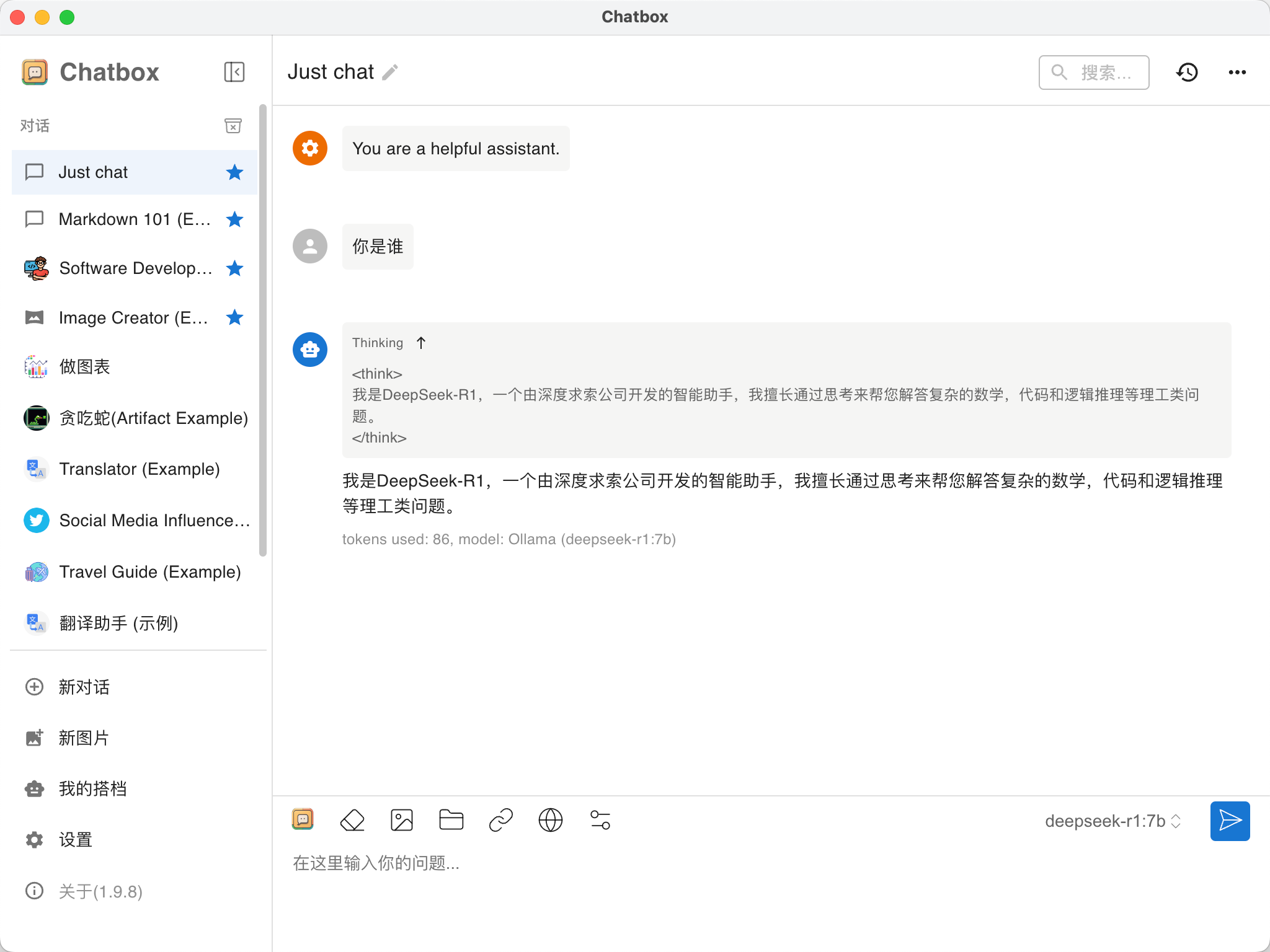

ChatBox

下载安装ChatBox后,点击设置,模型提供方选择OLLAMA API,API域名保持默认即可,模型根据部署实际情况选择

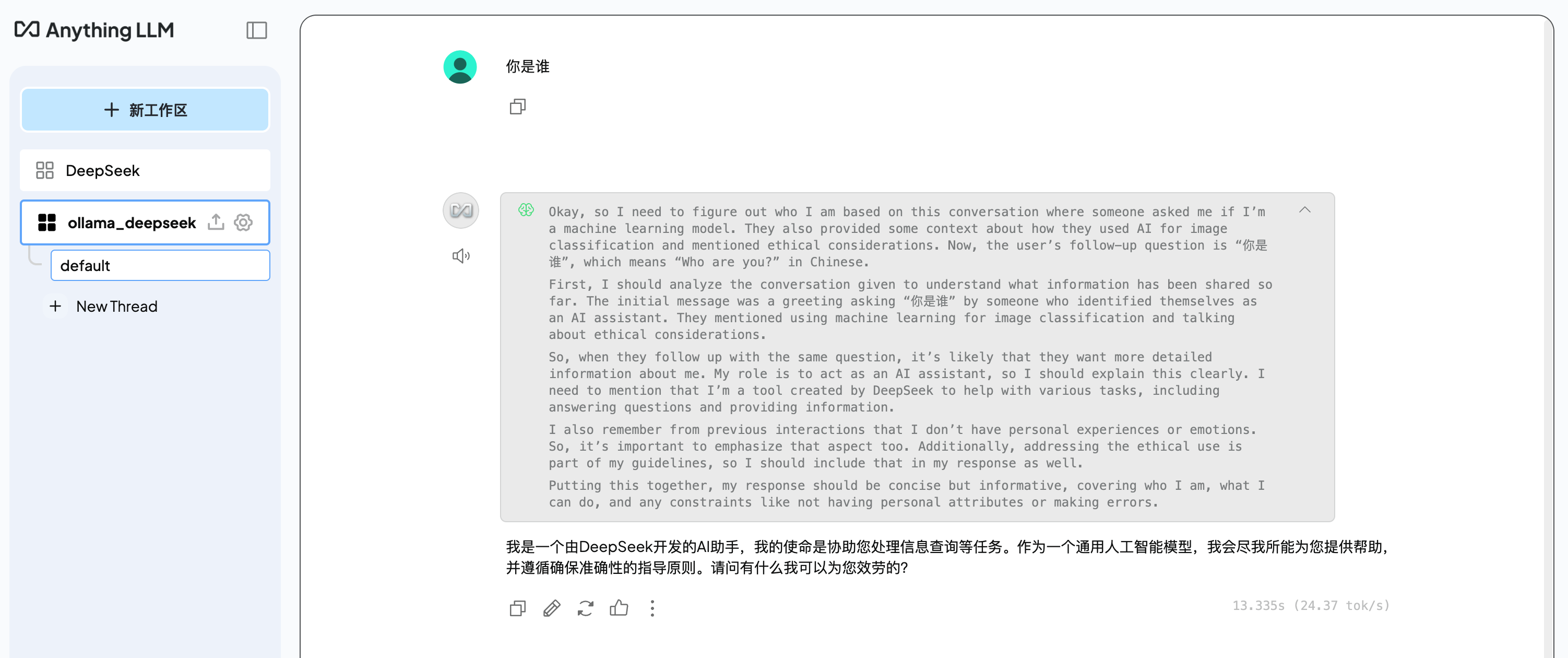

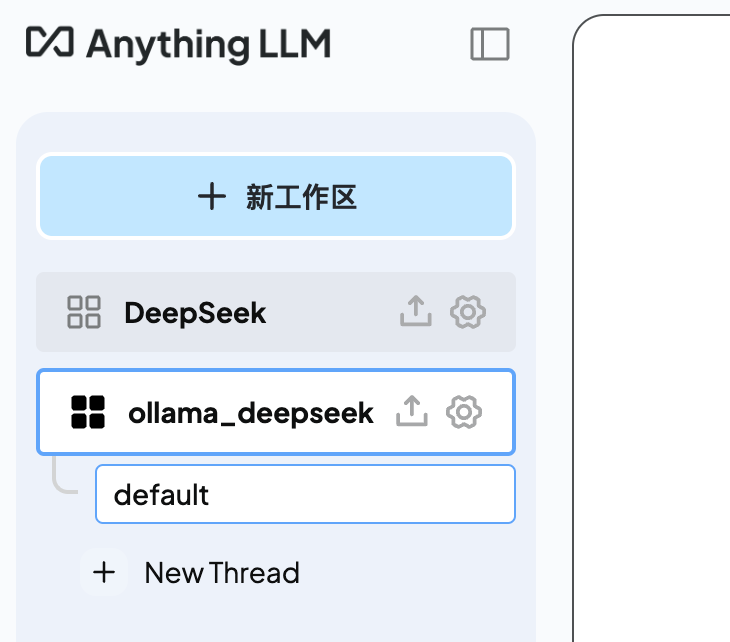

Anything LLM

安装Anything LLm后新建工作区

在聊天设置中配置工作区LLM提供者为Ollama,工作区聊天模型为deepseek-r1:7b